“Hombre programador, mujer asistente”. Sesgos de género en la IA

La IA encuentra útiles aplicaciones en cada vez más ámbitos de nuestra vida. Sin embargo, ello implica más riesgos en cuanto a los efectos que los algoritmos pueden tener, al replicar estereotipos relacionados con el género, raza o religión. Así, a pesar de las muchas ventajas de esta tecnología, comienzan a darse casos que hacen saltar las alarmas, haciendo necesario implementar medidas correctoras contra los sesgos algorítmicos para conseguir una sociedad digital e igualitaria.

IA, un futuro prometedor

Las aplicaciones de la inteligencia artificial no paran de aumentar. Los avances en tecnología de las últimas décadas han permitido que los algoritmos estén presenten en nuestra vida cotidiana: nos eligen las páginas de vídeos y entretenimiento que más nos gustan, aprendiendo de nuestras preferencias, e incluso siendo capaces de prevenir ciertas enfermedades analizando nuestros signos vitales, o ayudándonos a elegir la mejor ruta para no llegar tarde mediante geolocalización.

Comercio electrónico, finanzas, seguridad… la IA parece no tener techo en cuanto a sus usos en los negocios y la industria. Una auténtica revolución tecnológica, no exenta de los prejuicios de las personas que la crearon y a la que, por lo tanto, hay que “educar”.

Máquinas inteligentes

El objetivo de los científicos y científicas que trabajan en IA desde mediados de los años 30, es hacer que las máquinas piensen, y tengan un proceso cognitivo capaz de evaluar las situaciones y decidir qué hacer y en qué momento, e incluso, aprender de sus experiencias.

Sin embargo, por ahora, las máquinas no son capaces de pensar y tomar decisiones por sí solas. De momento, solo hacen o ejecutan aquello para lo que se les ha programado, y por tanto somos las personas las que hemos de introducir códigos éticos y evitar desviaciones en la información que se les facilita a estas máquinas inteligentes de aprendizaje automático.

Un caso reciente de sesgo algorítmico

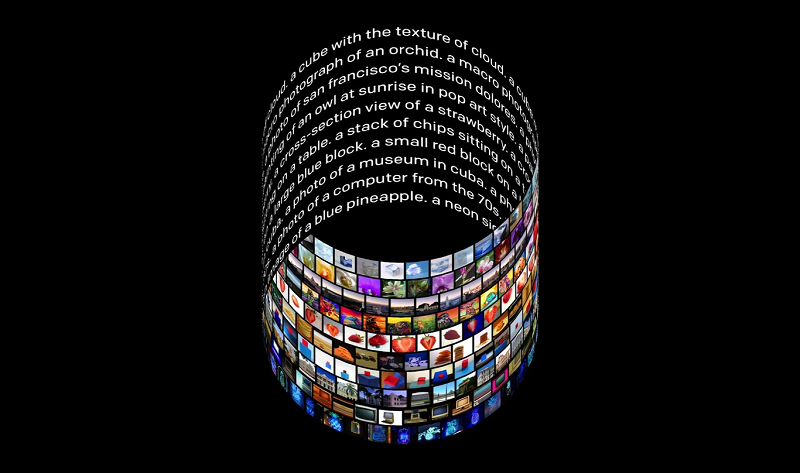

En los últimos meses, las redes sociales se han inundado de imágenes surrealistas, creadas por DALL-E. El autor, aunque tenga un nombre que recuerda al célebre pintor catalán, carece de estilo propio. Lo que hace es traducir las instrucciones escritas que se le dan, en montajes originales resultado de combinar millones de imágenes asociadas a dicho texto. El programa es capaz de establecer relaciones y arrojar nueve propuestas distintas cada vez que se le solicita.

Sobra decir que sus imágenes se han viralizado y han hecho las delicias de las personas internautas con las combinaciones imposibles desarrolladas por esta propuesta de OpenAI, una empresa impulsada por Elon Musk. Pero más allá de esta tendencia entre humorística y grotesca, también hay quienes han hecho caer en la cuenta, de los sesgos de género en el sistema, y los resultados sexistas u homófobos que arroja. Un hecho positivo, que apunta hacia una mayor concienciación social en torno a estos estereotipos.

Como ejemplo, a pesar de que en inglés las profesiones no tienen género, Dall-E sí que asocia perfiles cualificados con hombres, o a ciertas profesiones relacionadas tradicionalmente con ellos. Es el caso de términos como científico o programador. Sin embargo, cuando se le pide dibujar a un asistente, la herramienta opta siempre por una figura femenina.

Sesgos sociales heredados

Según el personal experto, son variados los factores que pueden influir en la generación de estos sesgos. En primer lugar, el sesgo de los propios los datos que analiza el sistema, que en el caso de Dall-E se trata de los millones de imágenes sacadas de internet y textos asociados a éstas. Otra razón, es el modelo de interpretación de los datos, ya que el peso que se dé a cada variable, influirá en el resultado del proceso algorítmico. Así como también es determinante el orden de las palabras asociadas a las imágenes. En función de cómo se hayan introducido los textos, habrá ciertos conjuntos de palabras que aparecerán más cerca unas que de otras.

Los propios creadores de Dall-E se han cubierto las espaldas, lanzando una advertencia de “Sesgos y limitaciones” bajo cada dibujo creado, para dejar claro que son conscientes de ellos, y que haberlos, los hay.

Un problema con solución

Efectivamente las personas especialistas apuntan a que estos resultados discriminatorios se pueden, y se deben corregir. A pesar de que herramientas como Dall-E o cualquier otra, no tengan como propósito principal representar la realidad, y aunque no resulte tarea fácil por la multitud de casuísticas que maneja la herramienta.

Para ello, proponen soluciones como mejorar la representatividad de las bases de datos, introducir normas que eviten los sesgos generados por los algoritmos, y limpiezas adicionales de datos automáticos. Y, por supuesto, aumentar la diversidad en las empresas tecnológicas, para ofrecer diferentes perspectivas de las que las máquinas puedan aprender.

Se trata de una labor de concienciación social y también de esfuerzo por parte de las empresas, que deben exigir en sus productos unos mínimos requisitos en torno a la igualdad, especialmente si se sabe cómo solucionar posibles sesgos, y a sabiendas de que ya están contribuyendo a reforzar estereotipos y agudizar los sesgos de género.